¿Has oído hablar de la IA multimodal pero no tienes claro en qué se diferencia de la IA tradicional? ¿Te preguntas cómo es posible que una misma herramienta entienda texto, analice imágenes, escuche audio o interactúe con vídeo en tiempo real? Si usas o has probado ChatGPT, Gemini o Copilot, ya has tenido entre manos modelos multimodales. En este artículo te explico qué son, cómo funcionan por dentro y por qué están redefiniendo la forma en que interactuamos con la tecnología.

La promesa es ambiciosa: sistemas capaces de comprender el mundo de la misma manera que lo hacemos las personas, combinando múltiples sentidos digitales. Para aprovecharlos con criterio —en el trabajo, en la educación o en tu día a día— conviene entender sus piezas clave, sus límites y cómo sacarles partido de forma segura y responsable.

Qué es un modelo de IA multimodal

Un modelo multimodal es un sistema de inteligencia artificial que puede procesar y razonar con diferentes tipos de datos o modalidades: texto, imágenes, audio, vídeo e incluso señales de sensores. A diferencia de los modelos unimodales (que solo manejan una modalidad, por ejemplo texto), la IA multimodal integra varias para obtener una comprensión más rica del contexto.

Ejemplos conocidos incluyen modelos de visión-lenguaje (capaces de describir imágenes con texto), modelos de habla-lenguaje (transcriben o sintetizan voz con comprensión semántica) y modelos de vídeo-lenguaje (razonan sobre secuencias temporales). En los últimos años han aparecido modelos más generales, como GPT‑4o y sus variantes en ChatGPT, Gemini 1.5 de Google o los modelos que impulsan Copilot de Microsoft, que aceptan entradas intercaladas de texto, imagen, audio o archivos y responden de forma unificada.

Esta integración no es solo una suma de capacidades: permite resolver tareas que antes eran difíciles o imposibles, como seguir instrucciones basadas en una foto de una pizarra, comprender un diagrama con anotaciones o responder sobre un vídeo manteniendo coherencia temporal.

Cómo funciona: arquitectura y entrenamiento

Representaciones y embeddings

La base de la multimodalidad son las representaciones numéricas de cada modalidad. Para el texto se usan embeddings de tokens; para imágenes, extracciones de características mediante encoders visuales (por ejemplo, redes tipo Vision Transformer); para audio, espectrogramas o embeddings acústicos. Estas representaciones llevan distintas modalidades a un espacio vectorial compatible, de modo que el modelo pueda relacionarlas.

Fusión y atención cruzada

Una vez obtenidas las representaciones, el modelo las combina mediante mecanismos de fusión (fusion) y atención cruzada (cross‑attention). La atención cruzada permite que el componente lingüístico “mire” a regiones relevantes de una imagen o fragmentos de audio mientras genera la respuesta. Hay varias estrategias:

- Encoders separados + decodificador común: cada modalidad tiene su encoder y un decodificador lingüístico (tipo transformador) integra todo.

- Adaptadores visuales acoplados a un LLM existente: se proyecta la información no textual a la “gramática” del LLM.

- Modelos nativamente multimodales: entrenados desde el inicio para consumir secuencias intercaladas de texto, imagen, audio o vídeo.

Alineamiento y aprendizaje contrastivo

Para que texto e imagen “se entiendan”, se usa a menudo aprendizaje contrastivo: pares emparejados (imagen ↔ descripción) se acercan en el espacio vectorial y los no emparejados se alejan. Modelos como CLIP popularizaron esta técnica. A partir de ahí, se afinan con instrucciones (instruction tuning) y refuerzo con retroalimentación humana para producir respuestas útiles y seguras.

Entrenamiento por etapas y datos

El entrenamiento suele seguir varias fases: preentrenamiento masivo en datos no supervisados (texto, imágenes, audio, vídeo), seguido de alineamiento con instrucciones y validación de seguridad. La calidad y diversidad de los datos es crítica: documentos escaneados, fotografías del mundo real, capturas de pantalla, diagramas técnicos, gráficos, audio con ruido, etc. Para vídeo, el modelo debe captar relaciones espacio‑temporales; se usan muestreos de fotogramas y módulos de atención temporal.

Razonamiento y herramientas: más allá del chat

El verdadero salto ocurre cuando el modelo multimodal puede usar herramientas: llamar a APIs, ejecutar código, buscar en la web o consultar bases de conocimiento. En escenarios empresariales destaca el RAG multimodal (búsqueda aumentada por recuperación), que permite adjuntar imágenes, PDF con tablas o audio de reuniones, indexarlos y fundamentar las respuestas con citas. Esto reduce alucinaciones y aporta verificabilidad.

IA multimodal en ChatGPT, Gemini y Copilot

ChatGPT

Las versiones más recientes integran modelos como GPT‑4o, capaces de comprender imágenes (por ejemplo, una fotografía de un circuito o un gráfico), leer documentos con tablas y mantener conversaciones por voz con baja latencia. Puede describir lo que ve, extraer texto de un cartel, explicar un diagrama paso a paso o razonar sobre capturas de pantalla. Gracias a los tools, puede además generar imágenes mediante modelos de difusión, ejecutar funciones y trabajar con archivos.

Gemini

Gemini 1.5 fue diseñado como nativamente multimodal, con ventanas de contexto muy amplias. Esto le permite ingerir grandes PDFs con imágenes, fragmentos de vídeo y audio asociados, y mantener coherencia en respuestas largas. En Android y en el ecosistema de Google, su multimodalidad se integra con el dispositivo: análisis de fotos, documentos de Drive y, en algunos casos, interacción en tiempo real con cámara y micrófono.

Copilot

Copilot combina modelos avanzados de lenguaje y visión para integrarse en Microsoft 365, Edge y Windows. Puede analizar capturas de pantalla, resumir PDFs con diagramas, ayudar a crear presentaciones con imágenes y responder sobre hojas de cálculo. En entornos corporativos, aprovecha datos de Microsoft Graph (según permisos) y puede invocar servicios como generación de imágenes creativas o búsqueda con contexto visual.

Casos de uso reales que ya aportan valor

- Productividad y documentación: resumir actas de reuniones (audio), extraer cifras de gráficos incrustados en PDFs (imagen + texto) y proponer acciones.

- Atención al cliente: interpretar fotos de productos dañados, validar formularios escaneados y responder con instrucciones visuales.

- Educación: tutoría paso a paso sobre problemas de matemáticas a partir de una foto de la pizarra; explicación de diagramas o mapas conceptuales.

- Accesibilidad: generar descripciones de imágenes para personas con discapacidad visual o explicar el contenido de una diapositiva.

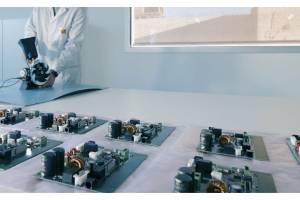

- Industria: inspección visual de calidad, lectura de contadores y análisis de vídeos de seguridad con criterios definidos.

- Comercio y búsqueda: búsqueda por imagen, recomendación contextual y extracción de atributos de catálogo.

Beneficios y límites que debes conocer

Ventajas clave

- Comprensión contextual: al combinar modalidades, las respuestas tienden a ser más útiles en tareas del mundo real.

- Interacción natural: hablar, mostrar y escribir en una misma conversación reduce fricción.

- Automatización rica: flujos que mezclan documentos, imágenes y audio permiten automatizar procesos complejos.

Límites y riesgos

- Alucinaciones y errores de percepción: el modelo puede describir detalles inexistentes o interpretar mal diagramas densos u OCR de baja calidad.

- Latencia y coste: procesar imágenes, audio o vídeo es más costoso que solo texto; hay que optimizar cargas y resoluciones.

- Privacidad y propiedad intelectual: cuidado al subir datos sensibles, rostros o material protegido; revisa configuración y políticas.

- Seguridad: pueden existir ataques de prompt injection en imágenes (pistas ocultas), audio manipulado o ejemplos adversarios.

- Sesgo y equidad: sesgos en datos visuales o de voz se trasladan a las salidas; es vital auditar y mitigar.

Cómo evaluar modelos multimodales

La comparación entre modelos requiere pruebas que reflejen tus tareas reales. Además de pilotos con usuarios, existen benchmarks de referencia:

- VQA y MMBench: preguntas y respuestas sobre imágenes generales.

- MMMU: retos multidisciplinares que exigen razonamiento visual‑textual.

- DocVQA/TextCaps: lectura y comprensión de documentos escaneados o imágenes con texto.

- AudioCaps y tareas ASR/diarización: calidad en comprensión de audio.

Además, incorpora evaluación humana, tasas de citación y verificabilidad, análisis de seguridad (resistencia a jailbreaks y a inyecciones visuales) y métricas operativas: latencia P95, consumo y coste por interacción.

Requisitos técnicos para adoptarlos

- Nube vs. edge: la nube ofrece más potencia y modelos grandes; el edge reduce latencia y mejora privacidad, útil para cámaras o móviles.

- Hardware: GPUs con memoria suficiente para lotes de imágenes/vídeo; en dispositivos, NPUs y aceleradores de IA mejoran la inferencia local.

- Formatos de entrada: normaliza imágenes (resolución/compresión), convierte PDFs a representaciones estructuradas y segmenta vídeo en clips.

- Optimización: cuantización y adapters para ajuste fino eficiente; almacenamiento en caché de embeddings y RAG para reducir tokens.

- Integración: APIs de OpenAI, Google y Microsoft exponen entradas multimodales y streaming de respuestas; planifica cuotas y gobernanza.

Buenas prácticas para empresas y desarrolladores

- Diseña el prompt multimodal: explica el objetivo, aporta contexto mínimo necesario e incluye ejemplos visuales claros. Evita imágenes borrosas o texto ilegible.

- Extrae estructura: para documentos, usa OCR de calidad y tablas estructuradas antes de preguntar al modelo; mejora precisión y coste.

- RAG multimodal: indexa imágenes, diagramas y audio con metadatos; devuelve citas y enlaces a las fuentes en las respuestas.

- Controles y seguridad: filtra contenidos sensibles, anonimiza datos, valida salidas con reglas de negocio y registra auditorías.

- Evaluación continua: establece conjuntos de pruebas y canaries; monitoriza deriva, latencia y fallos por modalidad.

- UX específica: permite al usuario previsualizar lo que el modelo “ve” (regiones resaltadas, transcripciones) y corregirlo si es necesario.

Consejos para usuarios de ChatGPT, Gemini y Copilot

- Comparte contexto visual útil: al subir una foto, añade una breve descripción de lo que necesitas: “identifica las columnas clave de esta tabla y crea un resumen de 5 puntos”.

- Pide razonamiento paso a paso con referencias: solicita pasos numerados y que cite qué parte de la imagen o documento respalda cada afirmación.

- Controla privacidad: desactiva el uso de tus datos para entrenamiento si tu caso lo requiere; evita subir información sensible o rostros sin consentimiento.

- Verifica: contrasta resultados críticos, especialmente medidas, cifras en gráficos y contenido de documentos escaneados.

- Combina modalidades: en una misma conversación, alterna imagen, texto y voz para concretar; suele mejorar precisión y velocidad.

Tendencias: hacia una IA verdaderamente integrada

- Tiempo real: modelos con latencias de voz a voz de decenas de milisegundos permitirán asistentes conversacionales que reaccionan a gestos y entonación.

- Vídeo y 3D: mejor comprensión de escenas dinámicas y relaciones espaciales, y generación de contenido coherente en secuencias largas.

- Personalización privada: perfiles y recuerdos controlados por el usuario, con ajuste en el dispositivo para preservar privacidad.

- Agentes capaces de actuar: orquestación de tareas entre aplicaciones, con verificación automática y seguridad por diseño.

- Datos sintéticos y evaluación robusta: creación de conjuntos multimodales controlados para cubrir casos raros y medir seguridad con mayor precisión.